AIが人間の知能をあらゆる面でを超えるのはまだまだ時期尚早なのかもしれませんが碁でのAlphaGoなど人間に勝つ分野が出てきているのは事実です。ただ電力効率という面ではまだまだ。AlphaGoを動かしているコンピュータの消費電力は250kW(25万W)を超えるのに対して人間の脳の消費電力は約20W。両者の差は1万倍 とまさに桁違い。現時点で首都圏の消費電力の12%を占めるというデータセンターの電力。2022年には国内のでデータセンターでAIにかかわる消費電力は4.8%との予想。 これからAIを活用しようにもクラウド側に置くにしろEdge側に置くにしろとにかくこの電力消費の問題は致命的な問題になりそうです。

AIの深層学習に使われるニューラルネットワークは、DNN : Deep Neural Networkといわれますが演算自体は比較的単純なものでシナプスを模したニューロンのネットワーク層から隠れた層を介して出力層を生み出す関数の重みづけの最適化=誤差が最小になるような計算を繰り返すもの。

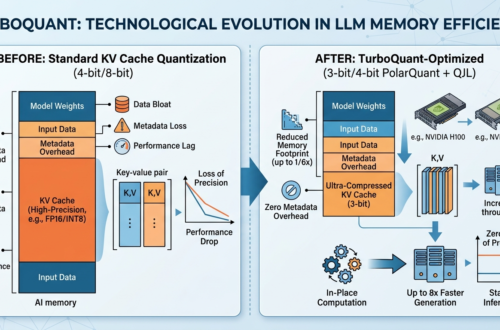

電力を要するのは重みづけの値が揮発性のメモリであるDRAMに保存されており演算の際に常にアクセスしに行くというのが背景にあります。対策としては①メモリ回路に演算の機能を組み込む、②メモリ回路と演算回路の距離を縮める、③演算の精度を実用的な範囲で低くするなんかがあるのですがそもそもはDRAMでの電力消費を減らすためにキャッシュしておく記憶装置を不揮発にしてしまおうというアプローチもあります。 それなりにスピードと容量が確保されるものが必要で候補としては抵抗変化メモリ(ReRAM)、相変化メモリ(PCM)、磁気抵抗メモリ(MRAM)、SLC=単値のフラッシュメモリなどなど。そもそもコスト的に勝てないと置き換えにならないですが 今後のAI活用に向けては一つの注目すべきポイントと言えそうです。

Please follow and like us: